ใช้ AI แพงขึ้นทุกเดือน?

เพราะเลือก Model และบริหาร Token ผิดวิธี

หลายธุรกิจเริ่มใช้ AI แล้วพบว่าค่าใช้จ่ายพุ่งสูงเร็วกว่าที่คาด — หรือได้ผลลัพธ์ไม่สม่ำเสมอแม้ใช้ตัวเดิม ปัญหาส่วนใหญ่ไม่ได้มาจาก AI แต่มาจากการ "เลือก model ผิดงาน" และ "ใช้ token เกินกว่าที่จำเป็น" บทความนี้จะอธิบายให้เข้าใจและแก้ได้จริง

ธุรกิจที่บริหาร token และเลือก model อย่างเป็นระบบ สามารถลดค่าใช้จ่าย AI ได้ 50–80% โดยไม่สูญเสียคุณภาพผลลัพธ์ — หัวใจคือการรู้ว่างานแต่ละประเภทต้องการ "พลัง" เท่าไร

Token คืออะไร — และทำไมมันถึงสำคัญ?

หน่วยที่ AI ใช้วัดและคิดเงิน

Token คือหน่วยที่ AI ใช้อ่านและเขียนข้อความ — คิดง่ายๆ ว่า 1 token ≈ 3–4 ตัวอักษรภาษาอังกฤษ หรือ 1–2 ตัวอักษรภาษาไทย ทุกครั้งที่คุณส่งข้อความให้ AI และรับคำตอบกลับมา ระบบจะนับจำนวน token ที่ใช้ทั้งหมด แล้วคิดค่าบริการตามนั้น

ตัวอย่างการนับ Token

ตัวเลขเหล่านี้สะสมเร็วมาก — โดยเฉพาะถ้าใช้ model ราคาแพงโดยไม่จำเป็น

3 สาเหตุหลักที่ทำให้ค่า AI แพงเกินจริง

ปัญหาที่พบบ่อยที่สุดในธุรกิจไทย

ใช้ model ที่แพงที่สุดกับทุกงาน

หลายทีมติด GPT-4o หรือ Claude Opus กับทุกงาน ทั้งที่งานตรวจ grammar หรือแปลภาษาง่ายๆ ไม่จำเป็นต้องใช้ model รุ่นท็อปเลย model รุ่นเล็กกว่าทำได้ดีพอๆ กัน ในราคาถูกกว่า 5–10 เท่า

แปะ context เยอะเกินความจำเป็น

บางทีม copy เอกสารทั้งหมดใส่ใน prompt ทุกครั้ง ทั้งที่คำถามใช้แค่บางส่วน — ทุก 1,000 token ของ context ที่ไม่จำเป็นคือเงินที่จ่ายฟรีไป ถ้าทำวันละ 100 ครั้ง ตัวเลขสะสมได้มากในหนึ่งเดือน

ไม่มี prompt template — สั่งใหม่ทุกครั้ง

การสั่งงานแบบ ad hoc โดยไม่มี template มาตรฐาน ทำให้ส่ง context ซ้ำๆ ในทุก session และได้ผลลัพธ์ไม่สม่ำเสมอ — สิ้นเปลืองทั้งเงินและเวลาในการแก้งาน

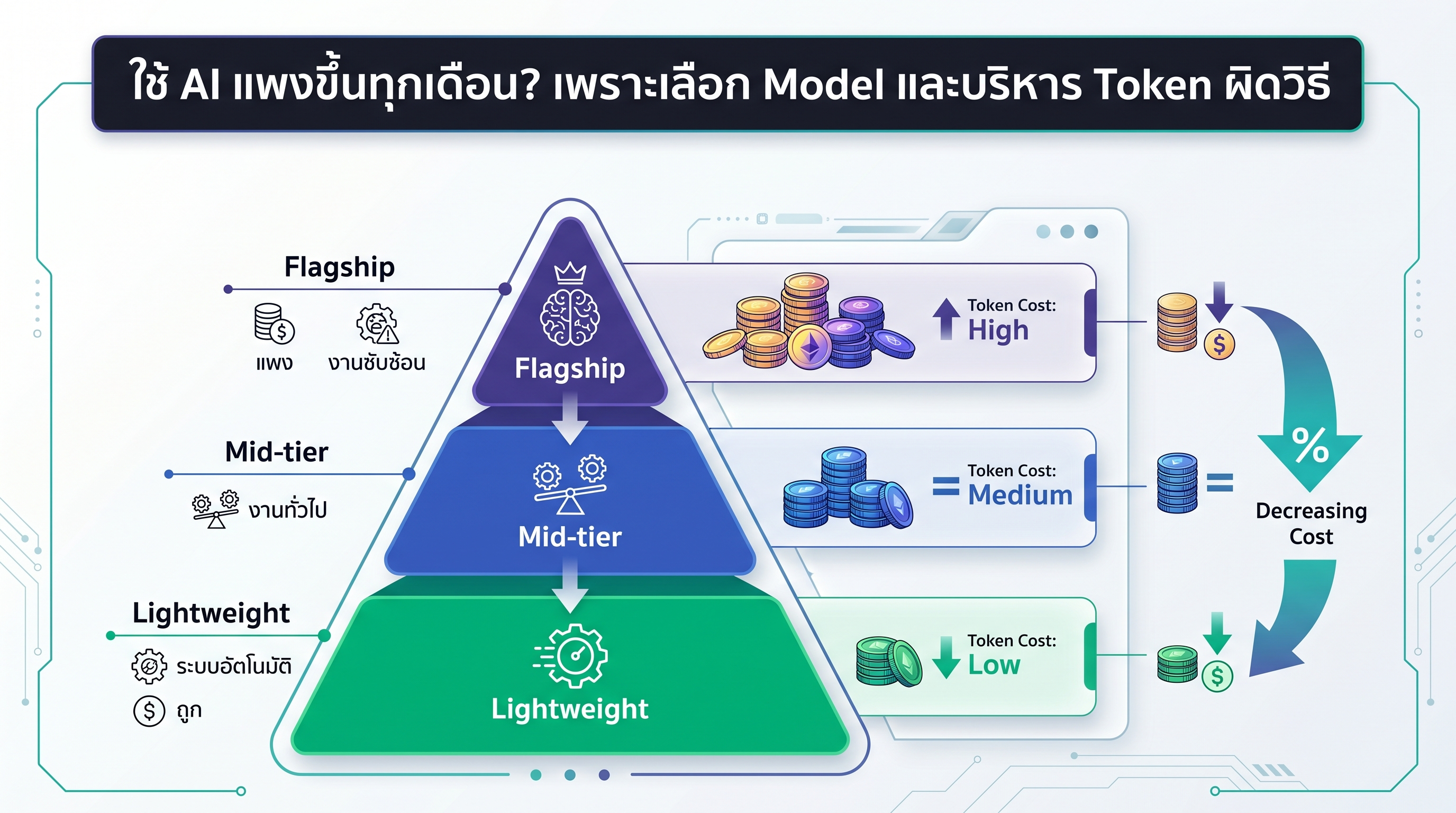

3 ระดับ Model — เลือกให้ตรงงาน

ไม่ใช่ทุกงานต้องใช้ model รุ่นท็อป

GPT-4o / Claude Opus / Gemini Ultra

ใช้เมื่อ: งานวิเคราะห์ซับซ้อน, เขียนเนื้อหาสำคัญที่ต้องการคุณภาพสูงสุด, reasoning หลายขั้น, งาน strategy ที่ผิดพลาดแล้วมีผลกระทบสูง

Claude Sonnet / GPT-4o mini / Gemini Flash

ใช้เมื่อ: งานประจำวันส่วนใหญ่ที่ต้องการคุณภาพดีแต่ไม่จำเป็นต้องดีที่สุด — จุดสมดุลระหว่างคุณภาพและต้นทุน

Claude Haiku / GPT-3.5 / Gemini Flash Lite

ใช้เมื่อ: งานซ้ำๆ ที่เรียบง่าย ปริมาณสูง ต้องการความเร็ว — ราคาถูกกว่า Flagship 10–20 เท่า

5 วิธีบริหาร Token ให้ประหยัดขึ้นทันที

ทำได้เลยโดยไม่ต้องเปลี่ยน AI ที่ใช้

ส่งเฉพาะ context ที่เกี่ยวข้อง ไม่ใช่เอกสารทั้งฉบับ

ถ้าถามเรื่องยอดขายเดือนมีนา ให้ส่งแค่ข้อมูลเดือนมีนา ไม่ต้องส่งรายงานทั้งปี — ตัดส่วนที่ไม่เกี่ยวข้องออกก่อนแปะใน prompt เสมอ

สร้าง Prompt Template มาตรฐานทีม

แทนที่จะให้ทุกคนสั่งงาน AI แบบใหม่ทุกครั้ง ให้สร้าง template สำหรับงานที่ทำบ่อย เช่น "สรุปอีเมล", "ตอบลูกค้า", "วิเคราะห์รายงาน" — template ดีทำครั้งเดียว ใช้ได้เสมอ ประหยัดทั้งเวลาและ token

กำหนดความยาวคำตอบล่วงหน้า

เพิ่มประโยคเช่น "ตอบไม่เกิน 3 bullet" หรือ "สรุปใน 2 ย่อหน้า" ใน prompt — AI จะตอบสั้นลงตามที่สั่ง ลด output token ได้ทันที โดยไม่เสียคุณภาพในงานที่ไม่ต้องการคำอธิบายยาว

แยกงานใหญ่เป็นงานย่อย

งาน "วิเคราะห์รายงาน 50 หน้า" ใน prompt เดียวใช้ token มหาศาล — แตกเป็น "สรุปหัวข้อ A" แล้วค่อย "สรุปหัวข้อ B" แยก session กัน ได้ผลลัพธ์ดีกว่า และควบคุมต้นทุนได้ดีกว่ามาก

ทดสอบ model รุ่นเล็กก่อนเสมอ

เวลาเจองานใหม่ ให้ทดสอบกับ model รุ่นเล็กก่อน ถ้าได้ผลดีพอ — ใช้รุ่นนั้น ไม่ต้องอัปเกรด อย่า assume ว่าต้องใช้ Flagship เสมอ ในงานประจำวันส่วนใหญ่ Mid-tier ให้ผลลัพธ์ 90% ของ Flagship ในราคาครึ่งหนึ่ง

กรอบบริหารค่าใช้จ่าย AI สำหรับธุรกิจไทย

จัดสรรให้ถูกประเภทงาน

งาน High-Stakes (~20%)

ลงทุนกับ Flagship model สำหรับงานที่คุณภาพมีผลต่อธุรกิจจริงๆ เช่น งาน strategy, สัญญา, เนื้อหาหน้าร้าน

งานประจำวัน (~60%)

ใช้ Mid-tier model สำหรับงานทั่วไปที่ทีมทำซ้ำๆ เช่น อีเมล, สรุปเอกสาร, content — คุณภาพดีพอและประหยัดกว่ามาก

งาน Automation (~20%)

ใช้ Lightweight model สำหรับงานอัตโนมัติที่รันซ้ำหลายพันครั้ง เช่น จัดหมวดหมู่, แท็ก, ตรวจคำ — ต้นทุนต่ำมาก

สรุป 5 ข้อที่ต้องจำ

Token คือหน่วยต้นทุน — ยิ่ง prompt ยาว context เยอะ ยิ่งแพง

ไม่มี model ที่ดีที่สุดสำหรับทุกงาน — มีแค่ model ที่เหมาะกับงานนั้นๆ

ส่ง context เท่าที่จำเป็น — อย่าแปะเอกสารทั้งฉบับถ้าถามแค่บางส่วน

Template มาตรฐาน คือการลงทุนที่คืนทุนเร็วที่สุด — ทำครั้งเดียว ใช้ได้เสมอ

ทดสอบ model เล็กก่อนเสมอ — ถ้าดีพอ อย่าจ่ายแพงกว่าโดยไม่จำเป็น

อยากวางระบบ AI ให้ธุรกิจคุณอย่างคุ้มค่า?

เราช่วยออกแบบ workflow AI ที่เลือก model ถูกตัว บริหาร token อย่างมีประสิทธิภาพ และวัดผลได้จริง — ปรึกษาฟรีไม่มีข้อผูกมัด

ปรึกษาฟรีผ่าน LINE